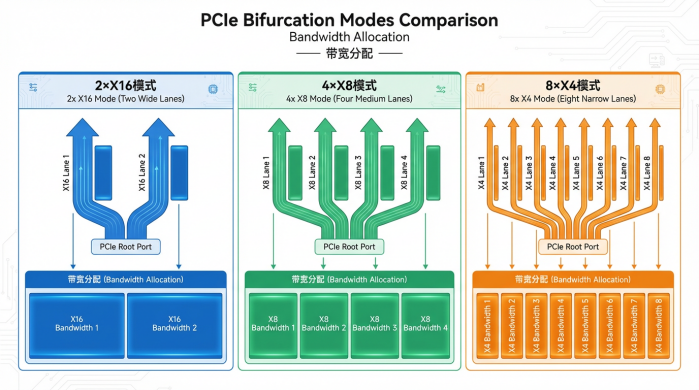

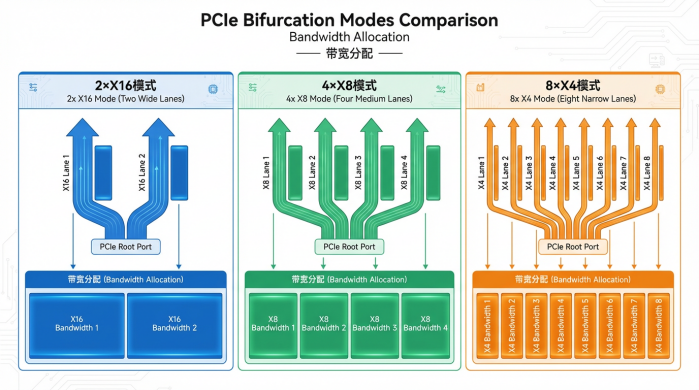

Com o rápido desenvolvimento do treinamento de grandes modelos de IA, da computação de alto desempenho e da computação em nuvem, a demanda das empresas por potência de computação de GPU de servidor e desempenho de armazenamento apresentou uma tendência de crescimento explosivo. No entanto, as arquiteturas de servidor tradicionais têm muitos gargalos nos recursos de expansão, como slots PCIe limitados, dificuldade em equilibrar a implementação de GPU e SSD e falta de flexibilidade nas soluções de expansão. Esses problemas restringiram muito a inovação nos negócios. Este documento analisará profundamente esses pontos problemáticos do setor e demonstrará como o LR-LINK LRSV9500-4I oferece às empresas uma solução de expansão em um único local por meio de modos flexíveis de bifurcação X4/X8/X16.

Dimensão de comparação | Solução tradicional | Solução LRSV9500-4I |

Capacidade de expansão | 1 slot = 1 dispositivo | 1 slot = 8 SSDs ou 2 GPUs |

Flexibilidade de configuração | Função fixa | Modos X4/X8/X16 comutáveis |

Balanceamento de GPU + SSD | Difícil de se reunir ao mesmo tempo | Perfeitamente compatível com o modo X8 |

Suporte a PCIe 5.0 | Suporte parcial | Suporte total a 32GT/s |

Interconexão de várias GPUs | Confiar no encaminhamento da CPU | Comunicação P2P |

II.TCasos típicos de aplicativos do setor

2.1 Centro de computação de IA: Cluster de treinamento com 8 GPUs

Uma empresa de IA criou uma plataforma avançada de treinamento de modelos grandes, usando o modo X16 do LRSV9500-4I para expandir as GPUs. 8 GPUs são conectadas por meio de 4 LRSV9500-4I cartões. Essa configuração melhora significativamente a utilização da GPU e a eficiência do treinamento.

2.2 Centro de dados da Internet: Pool de armazenamento totalmente flash

Um cluster de armazenamento distribuído é criado com o modo X4 do LRSV9500-4I, o que permite que um único servidor suporte 8 SSDs U.2 NVMe com uma capacidade total de 128 TB e uma largura de banda agregada de mais de 50 GB/s. A aplicação dessa tecnologia melhorou significativamente a escalabilidade e o desempenho do sistema, com o desempenho da consulta ao banco de dados aumentado em 10 vezes.

2.3 Estação de trabalho gráfica: Configuração híbrida de GPU + armazenamento

A produção cinematográfica e televisiva configura estações de trabalho no modo X8, equipadas com 2 placas gráficas com excelente desempenho em testes de renderização em tempo real e que podem melhorar significativamente a eficiência de renderização e exportação. Além disso, a configuração de 2 SSDs NVMe garante alta velocidade de leitura e gravação do armazenamento de material. Testes de desempenho profissional mostram que a velocidade de renderização de materiais de vídeo 4K aumentou em mais de 80% em comparação com as configurações tradicionais, e o tempo de exportação de vídeo de alta definição foi reduzido em 60%.

2.4 Plataforma de computação para pesquisa científica: Nós de computação heterogêneos

O centro de supercomputação usa nós de computação heterogêneos LRSV9500-4I para realizar a computação paralela de GPUs no modo X16 e a conexão eficiente de placas de aceleração FPGA e armazenamento NVMe no modo X8. Esse método de configuração flexível de computação, rede e armazenamento melhorou significativamente a utilização de recursos em 40%.

III.LRSV9500-4I Sugestões de seleção e configuração

3.1 Selecionar o modo de bifurcação de acordo com os cenários de aplicação

· Em cenários de treinamento de IA pura, é recomendável selecionar o modo X16 para maximizar a largura de banda da GPU única e, assim, oferecer suporte a placas de vídeo de última geração

· Em cenários de armazenamento puro, o modo X4 pode ser selecionado para maximizar o número de SSDs e criar um array totalmente flash de alta densidade

· Para cenários de carga mista, o modo X8 pode ser selecionado para equilibrar a configuração da GPU e do SSD, de modo a obter a alocação ideal de recursos

3.2 Principais indicadores de avaliação

· Compatibilidade com a placa-mãe: Confirme se a placa-mãe é compatível com PCIe 5.0

· Espaço do chassi: O LRSV9500-4I tem um design de meia altura, compatível com servidores 2U e superiores

· Condições de dissipação de calor: Certifique-se de que o duto de ar do servidor esteja desobstruído e que medidas auxiliares adicionais de dissipação de calor possam ser adicionadas, se necessário

· Qualidade do cabo: Use cabos MCIO de alta velocidade certificados para garantir a integridade dos sinais PCIe 5.0

IV.Perspectivas sobre as tendências de desenvolvimento tecnológico

Com o lançamento da especificação PCIe 6.0, sua taxa de transmissão atingiu 64GT/s por canal. A maturidade dessa tecnologia, combinada com o desenvolvimento da tecnologia CXL, trará novas oportunidades de desenvolvimento para as placas de expansão de switch PCIe. O desenvolvimento da tecnologia CXL, especialmente o suporte da CXL 2.0 para pooling de memória e arquitetura de switch, expandirá a função do PCIe Switch, que não se limitará mais à expansão de GPU e armazenamento, mas assumirá uma função importante na expansão da memória.

Ao mesmo tempo, com o crescimento contínuo da escala de parâmetros dos grandes modelos de IA, a demanda por largura de banda de interconexão de GPU se tornará mais urgente, o que pode ser visto pelo crescimento significativo da escala de mercado do setor de grandes modelos de IA e pelos avanços tecnológicos. A capacidade de interconexão de várias máquinas do PCIe Switch realizada por meio da função NTB se tornará uma tecnologia essencial para a criação de clusters de treinamento de IA em grande escala. A LR-LINK continuará a investir em P&D para oferecer aos clientes soluções de expansão mais avançadas.

Resumo

Os pontos problemáticos da GPU do servidor e da expansão do armazenamento são essencialmente a contradição entre recursos limitados e demanda ilimitada. Por meio da tecnologia PCIe Switch e dos modos flexíveis de bifurcação X4/X8/X16, o LRSV9500-4I oferece às empresas um caminho de solução eficiente. Seja para treinamento em IA, computação de alto desempenho, análise de big data ou produção de vídeo, o LRSV9500-4I pode oferecer excelentes recursos de expansão e proteção do investimento.

Como o principal produto da LR-LINK no campo do PCIe 5.0, o LRSV9500-4I, com base no desempenho líder do chip Broadcom PEX89048 e no suporte perfeito ao ecossistema, está se tornando a solução de expansão preferida para a construção de servidores e data centers de IA. Escolher o LRSV9500-4I significa escolher uma arquitetura de expansão flexível, eficiente e voltada para o futuro.

![]()