I.Qu'est-ce que le réseau InfiniBand ?

InfiniBand, souvent abrégé en "IB", est une norme de communication réseau et l'un des protocoles mettant en œuvre la technologie RDMA (Remote Direct Memory Access). Il utilise une technologie de signalisation différentielle à grande vitesse et des mécanismes de transmission parallèle multicanaux. Ses principaux objectifs sont de fournir "des performances élevées, une faible latence et une grande fiabilité".

InfiniBand est une technologie d'interconnexion dédiée au calcul haute performance (HPC) dans le domaine des serveurs. Elle se caractérise par un débit extrêmement élevé et une latence exceptionnellement faible, utilisés pour l'interconnexion de données entre ordinateurs (par exemple, réplication, charges de travail distribuées). InfiniBand est également utilisé comme interconnexion directe ou commutée entre les serveurs et les systèmes de stockage (comme les SAN et les systèmes de stockage à connexion directe), ainsi qu'entre les systèmes de stockage eux-mêmes. En outre, il facilite la communication entre les serveurs et les réseaux (tels que les réseaux locaux, les réseaux étendus et l'internet). Il est largement utilisé dans les centres de données et les domaines HPC/stockage. Par la suite, avec l'essor de l'intelligence artificielle, elle est devenue la technologie d'interconnexion de réseau de choix pour connecter les serveurs GPU.

II. Historique du développement d'InfiniBand

Au début des années 1990, Intel a été le premier à introduire la conception du bus PCI dans l'architecture standard des PC afin de prendre en charge le nombre croissant de périphériques externes. Cependant, à mesure que les processeurs, la mémoire, les disques durs et d'autres composants évoluaient rapidement, l'évolution plus lente du bus PCI est devenue un goulot d'étranglement pour l'ensemble du système. Pour résoudre ce problème, les géants de l'industrie informatique, notamment Compaq, Dell, HP, IBM, Intel, Microsoft et Sun, ainsi que plus de 180 autres entreprises, ont fondé conjointement la **IBTA (InfiniBand Trade Association)**.

L'objectif de l'IBTA était de rechercher de nouvelles technologies alternatives pour remplacer le PCI et résoudre le problème du goulot d'étranglement de la transmission. En conséquence, en 2000, la **spécification de l'architecture InfiniBand version 1.0** a été officiellement publiée. Elle a introduit le protocole RDMA, qui offre une latence plus faible, une plus grande largeur de bande, une plus grande fiabilité et permet des performances d'E/S nettement plus puissantes, s'imposant comme une nouvelle norme pour la technologie d'interconnexion des systèmes.

Parler d'InfiniBand conduit inévitablement à une société israélienne - **Mellanox** (nom chinois : , facilement mémorisable comme "vendre des vis"). Fondée en Israël en mai 1999 par plusieurs anciens employés d'Intel et de Galileo Technology, Mellanox a rejoint l'alliance industrielle InfiniBand peu après sa création. En 2001, elle a lancé son premier produit InfiniBand.

En 2002, le camp InfiniBand a connu un bouleversement majeur. Intel a "abandonné le navire", décidant de concentrer son développement sur **PCI Express (PCIe)**, qui a été lancé en 2004. Un autre géant, Microsoft, s'est également retiré du développement d'InfiniBand. Bien que des entreprises comme Sun et Hitachi soient restées engagées, l'avenir d'InfiniBand a été assombri.

À partir de 2003, InfiniBand s'est orienté vers un nouveau domaine d'application : "l'interconnexion de grappes d'ordinateurs". En 2005, il a trouvé une autre nouvelle application : "la connectivité des périphériques de stockage. Après 2012, sous l'impulsion de la croissance continue de la demande en matière de calcul à haute performance (HPC), la technologie InfiniBand a fait un bond en avant, augmentant régulièrement sa part de marché.

Au fur et à mesure que la technologie InfiniBand s'imposait, Mellanox s'est également développé et est devenu le leader mondial de la technologie InfiniBand."leader du marché" dans le domaine de l'InfiniBand. En 2010, Mellanox a fusionné avec Voltaire, laissant Mellanox (racheté par NVIDIA en 2019) et QLogic (racheté par Intel en 2012) comme principaux fournisseurs d'InfiniBand.

En 2013, Mellanox a acquis la société de technologie photonique au silicium Kotura et le fabricant de puces d'interconnexion optique parallèle IPtronics, renforçant ainsi son portefeuille industriel.

En 2015, la part de la technologie InfiniBand dans le marché de la téléphonie mobile a augmenté."TOP500" a dépassé les 50 % pour la première fois. Cela a marqué le premier dépassement de la technologie Ethernet par InfiniBand, qui est devenue la technologie la plus utilisée par les superordinateurs."technologie d'interconnexion de grappes privilégiée pour les superordinateurs".

En 2015, Mellanox détenait une"Part de 80" du marché mondial de l'InfiniBand. Leur champ d'activité s'est étendu des puces à l'ensemble de la gamme : adaptateurs de réseau, commutateurs/passerelles, systèmes de communication à distance et câbles/modules, ce qui leur a permis de s'imposer comme un fournisseur de réseaux de classe mondiale.

En 2019, NVIDIA a fait un grand pas en avant en acquérant Mellanox pour 1,5 milliard d'euros."6,9 milliards de dollars". Jensen Huang, CEO de NVIDIA, a déclaré : "Il s'agit de l'union de deux sociétés leaders dans le domaine de l'informatique à haute performance. NVIDIA se concentre sur l'accélération du calcul, tandis que Mellanox se concentre sur l'interconnexion et le stockage". Rétrospectivement, NVIDIA a fait preuve d'une remarquable clairvoyance : la formation de grands modèles s'appuie fortement sur des grappes de calcul à haute performance, et les réseaux InfiniBand sont le moyen le plus efficace d'améliorer la qualité de l'information et de la communication."partenaire optimal" pour ces groupes.

III. Fonctionnement d'InfiniBand

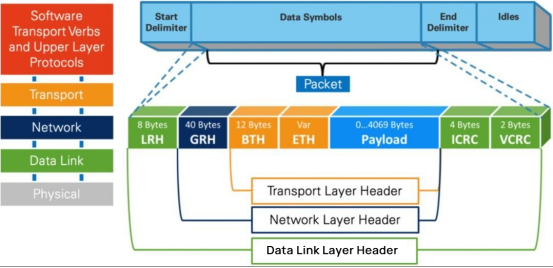

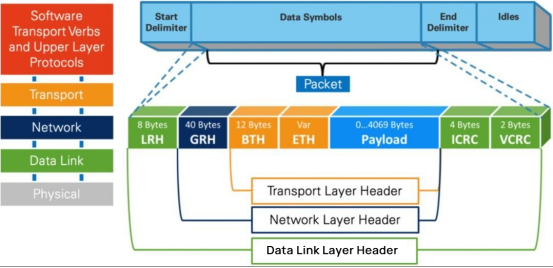

Les principes de fonctionnement d'InfiniBand peuvent sembler complexes pour ceux qui ne sont pas spécialisés dans les réseaux. Les débutants peuvent comprendre les bases ou sauter cette section. Le protocole InfiniBand adopte également un"architecture en couches"Chaque couche est indépendante et fournit des services à la couche supérieure.

Couche physique : Elle définit la manière dont les signaux binaires sont assemblés en symboles sur la liaison physique, puis en trames, en symboles de données et en remplissage de données entre les paquets. Elle détaille les protocoles de signalisation pour la construction de paquets valides, etc.

Couche liaison : Elle définit le format des paquets de données et les protocoles d'exploitation des paquets, tels que le contrôle de flux, le routage, le codage, le décodage, etc.

Couche réseau : Elle effectue le routage en ajoutant un en-tête d'itinéraire global (GRH) de 40 octets au paquet. Lors du transfert, les routeurs n'effectuent qu'un contrôle CRC variable, garantissant ainsi"intégrité de la transmission des données de bout en bout".

Couche transport : elle délivre les paquets à une paire de files d'attente (QP) spécifique et indique à la QP comment traiter le paquet. Le transport du réseau InfiniBand utilise la technologie CBFC (Credit-Based Flow Control) pour garantir la fiabilité et l'efficacité de la transmission des données. Ce mécanisme gère le crédit (représentant le volume de données que le récepteur peut accepter) entre l'expéditeur et le récepteur afin d'éviter la perte de paquets et la congestion.

La QP (Queue Pair) est l'unité de communication fondamentale de la technologie RDMA. Elle se compose d'une paire de files d'attente : la SQ (Send Queue) et la RQ (Receive Queue). Lorsque les utilisateurs appellent des API pour envoyer ou recevoir des données, ils placent essentiellement les données dans la QP. Les demandes contenues dans la QP sont ensuite traitées une par une selon le principe de l'interrogation.

Les avantages de"CBFC" peut être résumée en trois points principaux :

1. Évite la congestion : Grâce à l'ajustement dynamique des crédits et à la transmission sans perte, le CBFC prévient efficacement la congestion du réseau et la perte de paquets.

2. Amélioration de l'efficacité : l'expéditeur peut transmettre des données en continu sans attendre d'accusé de réception jusqu'à ce que le crédit soit épuisé, ce qui améliore l'efficacité du transfert de données.

3) Auto-configuration : le mécanisme de contrôle de flux s'active automatiquement lors de l'installation physique des dispositifs InfiniBand, sans nécessiter de configuration manuelle de la part de l'utilisateur.

Il est évident qu'InfiniBand définit ses propres formats des couches 1 à 4 (physique, liaison, réseau, transport), ce qui constitue un protocole de réseau complet. Le contrôle de flux de bout en bout est la base de l'envoi et de la réception des paquets du réseau InfiniBand, ce qui permet la réalisation d'un réseau sans perte très efficace.

Bien entendu, la réalisation du réseau InfiniBand à grande vitesse et sans perte repose également sur des technologies et des fonctionnalités telles que Socket Direct, Adaptive Routing, Subnet Manager (SM) pour la gestion des sous-réseaux, le partitionnement du réseau et le moteur SHARP (Scalable Hierarchical Aggregation and Reduction Protocol) pour l'optimisation du réseau. Ensemble, ces composants permettent d'obtenir les performances élevées, la faible latence et l'évolutivité qui font la réputation de la société.

![]()