أولاً: ما هي شبكة InfiniBand؟

يعد InfiniBand، الذي غالباً ما يتم اختصاره باسم "IB"، معياراً للاتصالات الشبكية وأحد البروتوكولات التي تطبق تقنية RDMA (الوصول المباشر للذاكرة عن بُعد). وهو يستخدم تقنية الإشارات التفاضلية عالية السرعة وآليات نقل متوازية متعددة القنوات. وتتمثل أهدافه الأساسية في توفير "أداء عالٍ ووقت استجابة منخفض وموثوقية عالية".

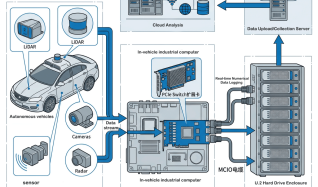

InfiniBand هي تقنية ربط بيني مخصصة للحوسبة عالية الأداء (HPC) في مجال الخوادم. وهي تتميز بإنتاجية عالية للغاية ووقت استجابة منخفض بشكل استثنائي، وتستخدم للربط البيني للبيانات بين أجهزة الكمبيوتر (على سبيل المثال، النسخ المتماثل، أحمال العمل الموزعة). كما يتم استخدام InfiniBand أيضاً كوصلة بينية مباشرة أو مبدلة بين الخوادم وأنظمة التخزين (مثل شبكات التخزين SAN والتخزين المتصل المباشر)، وكذلك بين أنظمة التخزين نفسها. بالإضافة إلى ذلك، فهي تسهل الاتصال بين الخوادم والشبكات (مثل الشبكات المحلية والشبكات الواسعة والإنترنت). ويستخدم على نطاق واسع في مراكز البيانات ومجالات الحوسبة عالية الأداء/التخزين. وفي وقت لاحق، ومع ظهور الذكاء الاصطناعي، أصبحت تقنية التوصيل البيني للشبكة المفضلة لتوصيل خوادم وحدة معالجة الرسومات.

II. تاريخ تطوير إنفيني باند

في أوائل التسعينيات، كانت شركة Intel رائدة في إدخال تصميم ناقل PCI في بنية الكمبيوتر الشخصي القياسية لدعم العدد المتزايد من الأجهزة الخارجية. ومع ذلك، مع ترقية وحدات المعالجة المركزية والذاكرة ومحركات الأقراص الصلبة والمكونات الأخرى بسرعة، أصبح التطور البطيء لناقل PCI عنق الزجاجة للنظام بأكمله. ولمعالجة هذه المشكلة، قام عمالقة صناعة تكنولوجيا المعلومات بما في ذلك Compaq وDell وHP وIBM وIBM وIntel وMicrosoft وSun، إلى جانب أكثر من 180 شركة أخرى، بتأسيس **رابطة تجارة InfiniBand**.

كان الغرض من إنشاء تقنية IBTA هو البحث عن تقنيات بديلة جديدة لتحل محل PCI وحل مشكلة عنق زجاجة الإرسال. ونتيجة لذلك، في عام 2000، تم إصدار **الإصدار 1.0 من مواصفات بنية النطاق المتداخل** رسميًا. وقدمت بروتوكول RDMA، الذي يوفر زمن استجابة أقل، وعرض نطاق ترددي أكبر، وموثوقية أعلى، وتمكين أداء إدخال/إخراج أقوى بكثير، مما جعله معيارًا جديدًا لتقنية الربط البيني للنظام.

الحديث عن InfiniBand يقودنا حتمًا إلى شركة إسرائيلية - **ميلانوكس** (الاسم الصيني: ، يمكن تذكره بسهولة - "بيع البراغي"). تأسست شركة Mellanox في إسرائيل في مايو 1999 على يد عدة موظفين سابقين في شركة Intel وGalileo Technology، وانضمت إلى تحالف صناعة InfiniBand بعد فترة وجيزة من تأسيسه. وفي عام 2001، أطلقوا أول منتج من منتجات InfiniBand.

في عام 2002، واجه معسكر InfiniBand اضطرابًا كبيرًا. فقد قررت شركة Intel "التخلي عن السفينة"، وقررت تحويل تركيزها في التطوير إلى **PCI Express (PCIe)**، الذي تم إطلاقه في عام 2004. كما انسحبت شركة عملاقة أخرى، مايكروسوفت، من تطوير InfiniBand. وعلى الرغم من أن شركات مثل Sun وHetachi ظلت ملتزمة بتطوير إنفيني باند، إلا أن مستقبل إنفيني باند قد طغى على مستقبلها.

وابتداءً من عام 2003، تمحورت InfiniBand نحو مجال تطبيق جديد: "الربط البيني بين مجموعات الحواسيب". وفي عام 2005، وجدت تطبيقاً جديداً آخر: "توصيل أجهزة التخزين". بعد عام 2012، مدفوعًا بالنمو المستمر في متطلبات الحوسبة عالية الأداء (HPC)، قفزت تقنية InfiniBand إلى الأمام، مما أدى إلى زيادة حصتها في السوق بشكل مطرد.

ومع بروز تقنية InfiniBand تدريجيًا، نمت شركة Mellanox أيضًا وأصبحت"رائد السوق" في InfiniBand. في عام 2010، اندمجت شركة Mellanox مع شركة Voltaire، تاركةً Mellanox (استحوذت عليها NVIDIA في عام 2019) وQLogic (استحوذت عليها Intel في عام 2012) كموردي InfiniBand الأساسيين.

في عام 2013، استحوذت شركة Mellanox على شركة Kotura لتكنولوجيا السيليكون الضوئية وشركة IPtronics لصناعة الرقائق البينية الضوئية الموازية، مما عزز محفظتها في هذا المجال.

في عام 2015، كانت حصة تكنولوجيا InfiniBand في"TOP500" تجاوزت قائمة الحواسيب الفائقة 50% للمرة الأولى. كان هذا إيذانًا بتجاوز تقنية InfiniBand لتقنية Ethernet، لتصبح"تقنية الوصلة البينية العنقودية المفضلة للحواسيب الفائقة".

بحلول عام 2015، كان لدى Mellanox"80% من الحصة" في سوق إنفيني باند العالمي. وقد توسع نطاق أعمالهم من الرقائق ليشمل الطيف الكامل: محولات الشبكة، والمفاتيح/البوابات وأنظمة الاتصالات عن بُعد والكابلات/الوحدات، مما جعلهم مزوداً عالمياً للشبكات.

في عام 2019، قامت شركة NVIDIA بخطوة مهمة، حيث استحوذت على شركة Mellanox مقابل"6.9 مليار دولار". صرح جنسن هوانج، الرئيس التنفيذي لشركة NVIDIA، قائلاً: "هذا هو اتحاد شركتين رائدتين عالميًا في مجال الحوسبة عالية الأداء. تركز NVIDIA على الحوسبة المتسارعة، بينما تركز Mellanox على الربط البيني والتخزين." لقد أظهرت NVIDIA بعد فوات الأوان بُعد نظر ملحوظ: يعتمد تدريب النماذج الكبيرة اعتمادًا كبيرًا على مجموعات الحوسبة عالية الأداء، وشبكات InfiniBand هي"الشريك الأمثل" لهذه التكتلات.

ثالثاً. كيف يعمل InfiniBand

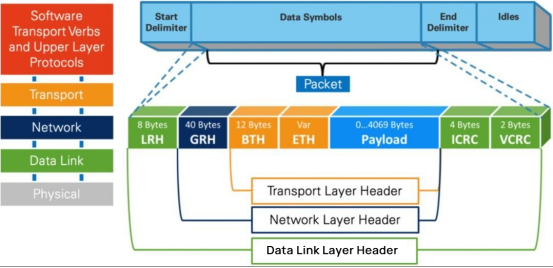

قد تبدو مبادئ عمل InfiniBand معقدة لمن هم خارج تخصصات الشبكات. يمكن للمبتدئين استيعاب الأساسيات أو تخطي هذا القسم. يعتمد بروتوكول InfiniBand أيضًا على بروتوكول"هندسة معمارية متعددة الطبقات"حيث تكون كل طبقة مستقلة وتقدم خدمات للطبقة التي فوقها.

الطبقة الفيزيائية: تحدد كيفية تجميع إشارات البت في رموز على الرابط المادي، ثم في إطارات ورموز بيانات وتعبئة البيانات بين الحزم. وهي تفصّل بروتوكولات الإشارات لإنشاء حزم صالحة، وما إلى ذلك.

طبقة الارتباط: تحدد تنسيق حزم البيانات والبروتوكولات الخاصة بعمليات الحزم، مثل التحكم في التدفق والتوجيه والتشفير وفك التشفير والترميز وما إلى ذلك.

طبقة الشبكة: تقوم بالتوجيه عن طريق إضافة رأس مسار عالمي (GRH) مكون من 40 بايت إلى الحزمة. أثناء إعادة التوجيه، تقوم أجهزة التوجيه بإجراء فحص CRC متغير فقط، مما يضمن"سلامة نقل البيانات من البداية إلى النهاية".

طبقة النقل: تقوم بتوصيل الحزم إلى زوج قائمة انتظار (QP) محدد، وتوجهها إلى كيفية معالجة الحزمة. يستخدم النقل عبر شبكة InfiniBand تقنية التحكم في التدفق المستند إلى الرصيد (CBFC) لضمان موثوقية وكفاءة نقل البيانات. تعمل هذه الآلية على إدارة الرصيد (الذي يمثل حجم البيانات التي يمكن أن يقبلها جهاز الاستقبال) بين المرسل والمستقبل لمنع فقدان الحزمة والازدحام.

QP (زوج قائمة الانتظار) هو وحدة الاتصال الأساسية في تقنية RDMA. وهي تتكون من زوج من قوائم الانتظار: SQ (قائمة انتظار الإرسال) و RQ (قائمة انتظار الاستقبال). عندما يستدعي المستخدمون واجهات برمجة التطبيقات لإرسال البيانات أو استقبالها، فإنهم يضعون البيانات بشكل أساسي في QP. ثم تتم معالجة الطلبات في QP واحدًا تلو الآخر بطريقة الاقتراع.

مزايا"CBFC" يمكن تلخيص التكنولوجيا في ثلاث نقاط رئيسية:

1. يتجنب الازدحام: من خلال تعديل الرصيد الديناميكي والإرسال بدون فقدان، يمنع CBFC بشكل فعال ازدحام الشبكة وفقدان الحزمة.

2. تحسين الكفاءة: يمكن للمرسل إرسال البيانات بشكل مستمر دون انتظار الإشعارات حتى استنفاد الرصيد، وبالتالي تعزيز كفاءة نقل البيانات.

3- التهيئة التلقائية: يتم تنشيط آلية التحكم في التدفق تلقائيًا عند التثبيت الفعلي لأجهزة InfiniBand، مما لا يتطلب تهيئة يدوية من المستخدم.

كما هو واضح، يحدد InfiniBand تنسيقات الطبقة 1-4 الخاصة به (الفيزيائية والرابط والشبكة والنقل)، مما يشكل بروتوكول شبكة كامل. يعد التحكم في التدفق من طرف إلى طرف هو الأساس لإرسال واستقبال حزم شبكة InfiniBand، مما يتيح تحقيق شبكة فعالة للغاية بدون فقدان.

وبالطبع، فإن تحقيق شبكة InfiniBand عالية السرعة والخالية من الخسائر يعتمد أيضًا على تقنيات وميزات مثل Socket Direct، والتوجيه التكيفي، ومدير الشبكة الفرعية (SM) لإدارة الشبكة الفرعية، وتقسيم الشبكة، ومحرك SHARP (بروتوكول التجميع الهرمي القابل للتطوير والتخفيض) لتحسين الشبكة. توفر هذه المكونات مجتمعةً أداءً عاليًا مميزًا ووقت استجابة منخفض وقابلية توسع سهلة.