I. InfiniBandネットワークとは何か?

InfiniBand(しばしば「IB」と略される)は、ネットワーク通信の標準規格であり、RDMA(リモート・ダイレクト・メモリ・アクセス)技術を実装するプロトコルの一つです。高速差動信号技術とマルチチャネル並列伝送機構を利用しており、主な目的は「高性能、低遅延、高信頼性」を提供することです。

InfiniBandは、サーバー領域におけるハイパフォーマンスコンピューティング(HPC)に特化したインターコネクト技術です。極めて高いスループットと非常に低いレイテンシを持ち、コンピュータ間のデータ接続(例:レプリケーション、分散ワークロード)に使用されます。また、サーバーとストレージシステム(SANや直結ストレージなど)間、あるいはストレージシステム同士を直接またはスイッチ経由で接続するのにも用いられます。さらに、サーバーとネットワーク(LAN、WAN、インターネットなど)間の通信にも活用されます。データセンターおよびHPC/ストレージ分野で広く利用されています。その後、人工知能(AI)の台頭とともに、GPUサーバーを接続するためのネットワークインターコネクト技術として選ばれるようになりました。

II. InfiniBandの開発歴史

1990年代初頭、Intelは外部デバイスの増加に対応するため、PCIバス設計を標準PCアーキテクチャに導入しました。しかし、CPU、メモリ、ハードディスクなどの部品が急速に進化する中で、PCIバスの進化が遅れ、システム全体のボトルネックとなってしまいました。この問題に対処するため、Compaq、Dell、HP、IBM、Intel、Microsoft、SunなどをはじめとするIT業界の大手企業とその他180社以上が共同で**IBTA(InfiniBand貿易協会)**を設立しました。

IBTAの目的は、PCIに代わる新たな技術を研究し、伝送ボトルネックを解決することでした。その結果、2000年に**InfiniBand Architecture Specification version 1.0**が正式に発表されました。これはRDMAプロトコルを導入し、より低いレイテンシ、より大きな帯域幅、高い信頼性を提供し、大幅に強化されたI/O性能を実現することで、システムインターコネクト技術の新標準として確立されました。

InfiniBandといえば、避けて通れないイスラエルの企業――**Mellanox**(中国語名:,覚えやすいのは「ねじを売る」)があります。1999年5月にIntelとGalileo Technologyの元従業員数名によってイスラエルで設立されたMellanoxは、設立直後にInfiniBand業界連盟に参加しました。2001年には、初のInfiniBand製品を発売しました。

2002年、InfiniBand陣営は大きな動揺に見舞われます。Intelが「船から降りて」、2004年に登場した**PCI Express(PCIe)**へ開発重点を移行すると決定しました。もう一つの巨人であるMicrosoftもInfiniBandの開発から撤退しました。Sunや日立製作所などの企業は継続して取り組みましたが、InfiniBandの将来は不透明になりました。

2003年以降、InfiniBandは新たな応用分野である「コンピュータクラスタのインターコネクト」へ方向転換します。2005年には、「ストレージ装置の接続性」という新たな用途を見つけました。2012年以降、ハイパフォーマンスコンピューティング(HPC)需要の持続的成長に牽引され、InfiniBand技術は飛躍的に発展し、市場シェアを着実に拡大しました。

InfiniBand技術が徐々に注目を集めるようになると、Mellanoxも成長を遂げ、"市場リーダー"となりました。2010年、MellanoxはVoltaireと合併し、その後Mellanox(2019年にNVIDIAが買収)とQLogic(2012年にIntelが買収)が主要なInfiniBandサプライヤーとして残りました。

2013年、Mellanoxはシリコンフォトニクス技術企業Koturaと並列光インターコネクトチップメーカーIPtronicsを買収し、業界でのポジションをさらに強固にしました。

2015年、InfiniBand技術の"TOP500"スーパーコンピュータランキングにおけるシェアが初めて50%を超えました。これはInfiniBandがEthernet技術を初めて上回ったことを意味し、"スーパーコンピュータ向けクラスタインターコネクト技術としての最有力候補".

となりました。"2015年時点で、Mellanoxは世界のInfiniBand市場で"80%のシェア

を占めていました。事業範囲はチップからネットワークアダプタ、スイッチ/ゲートウェイ、リモート通信システム、ケーブル/モジュールまで広がり、世界的なネットワークプロバイダーとしての地位を確立しました。"2019年、NVIDIAはMellanoxを"69億ドル"で買収しました。NVIDIAのCEOであるジェンセン・フアン氏は次のように述べています。「これはハイパフォーマンスコンピューティング分野で世界をリードする二つの企業の統合です。NVIDIAはアクセラレーテッドコンピューティングに注力し、Mellanoxはインターコネクトとストレージに注力しています。」後になって振り返れば、NVIDIAは卓越した先見性を示していました。大規模モデルの学習はハイパフォーマンスコンピューティングクラスタに大きく依存しており、InfiniBandネットワークはそのようなクラスタにとって"最適なパートナー

なのです。

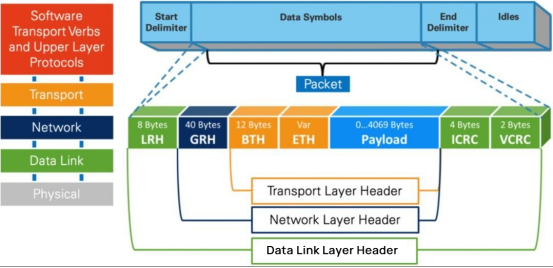

III. InfiniBandの動作原理"ネットワーキングの専門家以外にとっては、InfiniBandの動作原理は複雑に感じられるかもしれません。初心者は基本的な理解を得るか、このセクションをスキップしても構いません。InfiniBandプロトコルも"階層型アーキテクチャ

を採用しており、各層は独立しており、それぞれ上位の層にサービスを提供します。

物理層:物理リンク上でビット信号がシンボルとしてどのように構成され、フレーム、データシンボル、パケット間のデータフィルとなるかを定義します。有効なパケットを構築するための信号プロトコルなどを詳細に規定しています。

リンク層:データパケットのフォーマットと、フロー制御、ルーティング、符号化、復号化などのパケット操作に関するプロトコルを定義します。"ネットワーク層:パケットに40バイトのグローバルルーティングヘッダー(GRH)を追加してルーティングを行います。転送時には、ルーターが可変CRCチェックのみを実行し、".

エンドツーエンドのデータ伝送完全性

を保証します。トランスポート層:パケットを特定のキューペア(QP)に届け、QPに対してパケットの処理方法を指示します。InfiniBandネットワークのトランスポートでは、信頼性と効率を確保するために、クレジットベースのフロー制御(CBFC)技術を使用しています。この仕組みは、送信側と受信側の間でクレジット(受信側が受け入れ可能なデータ量を表す)を管理し、パケット損失や輻輳を防ぎます。

QP(キューぺア)はRDMA技術における基本的な通信単位です。SQ(送信キュー)とRQ(受信キュー)の2つのキューから構成されます。ユーザーがAPIを呼び出してデータを送受信する際、実質的にはデータをQPに投入していることになります。QP内のリクエストは、ポーリング方式で順番に処理されます。"CBFC"技術の利点は主に以下の3点にまとめられます:

1. 輻輳の回避:動的クレジット調整とロスレス伝送により、CBFCはネットワークの輻輳とパケット損失を効果的に防止します。

2. 効率の向上:クレジットが尽きるまで、送信側は確認応答を待たずに連続してデータを送信できるため、データ転送効率が向上します。

3. 自動設定:InfiniBandデバイスを物理的に設置すると、フロー制御機構が自動的に有効になり、ユーザーによる手動設定は不要です。

明らかに、InfiniBandは独自の第1~4層(物理層、リンク層、ネットワーク層、トランスポート層)のフォーマットを定義しており、完全なネットワークプロトコルを構成しています。エンドツーエンドのフロー制御は、InfiniBandネットワークパケットの送受信の基盤であり、非常に効果的なロスレスネットワークの実現を可能にしています。

当然のことながら、InfiniBandの高速かつロスレスネットワークを実現するには、Socket Direct、アダプティブルーティング、サブネット管理のためのサブネットマネージャ(SM)、ネットワーク分割、そしてSHARP(Scalable Hierarchical Aggregation and Reduction Protocol)エンジンによるネットワーク最適化などの技術や機能も不可欠です。これらが一体となって、特徴的な高性能、低遅延、容易なスケーラビリティを実現しています。