Mit der rasanten Entwicklung der künstlichen Intelligenz sind KI-Server und GPU-Cluster zur zentralen Recheninfrastruktur von Rechenzentren geworden. Diese Anwendungen, die vom Training großer Sprachmodelle bis hin zu Echtzeit-Inferenzdiensten reichen, stellen beispiellose Anforderungen an die Rechenleistung und den Datendurchsatz. Bei der zugrunde liegenden Architektur, die diese Hochleistungssysteme unterstützt, steht die Hochgeschwindigkeitssignalübertragungstechnologie vor großen Herausforderungen.

Nach Angaben von Branchenforschungsinstituten überstieg der weltweite GPU-Markt 40 Milliarden Dollar im Jahr 2024, mit einer jährlichen Wachstumsrate von über 30 %. Ein einziger KI-Trainingsserver kann 8 oder mehr Hochleistungs-GPUs integrieren, die durch Hochgeschwindigkeitsverbindungen einen einheitlichen Rechenpool bilden. Eine solche High-Density-Computing-Architektur stellt extrem hohe Anforderungen an die Datenübertragungsbandbreite und die Signalqualität innerhalb des Servers.

Auch bei den Speichersystemen vollzieht sich derzeit ein Wandel. Herkömmliche SATA- und SAS-Speicher können die Anforderungen von KI-Workloads nicht mehr erfüllen, und Hochgeschwindigkeits-SSDs auf Basis des NVMe-Protokolls setzen sich durch. Die neue Generation CXL (Compute Express Link) Technologie verbessert die Speichererweiterung und Speicherkonvergenz weiter, indem sie es GPUs und CPUs ermöglicht, auf entfernte Speicher- und Speicherressourcen in einer cache-kohärenten Weise zuzugreifen.

Als Mainstream-Standard für die interne Geräteverbindung in Servern hat sich PCI Express (PCIe) zu seiner 5. PCIe 5.0 erhöht die Übertragungsrate pro Lane von 16GT/s (PCIe 4.0) auf 32GT/sund verdoppelt damit die Bandbreite pro Lane. Bei Grafikkarten oder Netzwerkadaptern in x16-Konfiguration kann die theoretische bidirektionale Bandbreite folgende Werte erreichen 128GB/s.

Höhere Übertragungsraten bringen jedoch auch neue technische Herausforderungen mit sich:

· Signalabschwächung: Hochgeschwindigkeitssignale erleiden Verluste, wenn sie über Leiterbahnen und Steckverbinder übertragen werden; die Dämpfung nimmt bei höheren Frequenzen zu. PCIe 5.0-Signale haben eine kürzere effektive Übertragungsdistanz als PCIe 4.0 und erfordern ein strengeres Routing-Design.

· Signalintegrität: Hochgeschwindigkeitssignale sind anfälliger für Übersprechen, Reflexion und Rauschen, was zu Datenübertragungsfehlern führen und die Systemstabilität beeinträchtigen kann.

· Zeitlicher Spielraum: Höhere Datenraten bedeuten engere Zeitfenster und damit strengere Anforderungen an die Taktsynchronisation und die Signalflankengenauigkeit.

Zur Bewältigung der Herausforderungen bei der Hochgeschwindigkeitssignalübertragung, Retimer Technologie aufgetaucht ist. Ein Retimer ist ein Signalregenerator im Hochgeschwindigkeitssignalweg, der gedämpfte Signale erkennt, wiederherstellt und neu synchronisiert, um die effektive Übertragungsstrecke zu verlängern und die Signalintegrität zu verbessern.

Im Gegensatz zu einfachen Signalverstärkern (Redriver) erfolgt die Signalregeneration bei Retimern durch folgende Mechanismen:

· Signal-Entzerrung: Kompensiert die Dämpfung der hohen Frequenzen und stellt die Signalamplitude wieder her.

· Takt- und Datenwiederherstellung (CDR): Extrahiert den Takt aus dem Eingangssignal, um Jitter zu eliminieren.

· Signal-Retiming: Regeneriert saubere Datensignale unter Verwendung des wiederhergestellten Taktes.

· Transparenz des Protokolls: Analysiert den Dateninhalt nicht und ist für Protokolle der oberen Schicht völlig transparent.

In KI-Servern und High-End-Speichersystemen sind Retimer-Chips zu kritischen Komponenten geworden, die eine zuverlässige Hochgeschwindigkeitssignalübertragung gewährleisten. Sie spielen eine unverzichtbare Rolle bei der Verbindung zwischen GPUs und CPUs sowie bei erweiterten Verbindungen für NVMe-SSDs.

CXL (Compute Express Link) ist ein neues Hochgeschwindigkeits-Verbindungsprotokoll, das auf der physikalischen Schicht von PCIe 5.0 basiert, aber über umfangreichere Funktionen verfügt. Der CXL 2.0-Standard unterstützt drei Protokolle:

· CXL.io: Kompatibel mit PCIe-Protokollen zur Geräteerkennung und -konfiguration.

· CXL.cache: Unterstützt Geräte-Cache-Kohärenz, so dass Geräte den CPU-Cache gemeinsam nutzen können.

· CXL.Speicher: Unterstützt den speichersemantischen Zugriff, so dass Geräte direkt auf den Systemspeicher zugreifen können.

Der Kernwert der CXL-Technologie besteht darin, den Engpass des CPU-Speichers in herkömmlichen Architekturen zu überwinden und Beschleunigern wie GPUs und FPGAs den Zugriff auf Speicherpools mit großer Kapazität auf kohärente Weise zu ermöglichen. Dies ist entscheidend für KI-Training und Big-Data-Anwendungen, die viel Speicher benötigen.

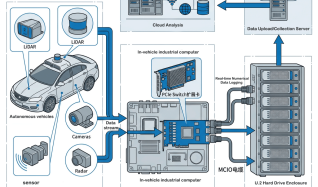

MCIO (Mini Cool Edge IO) ist ein kompakter Hochgeschwindigkeits-Steckverbinderstandard, der für PCIe- und CXL-Anwendungen der nächsten Generation entwickelt wurde. MCIO bietet die folgenden Vorteile:

· Höhere Dichte: Unterstützt mehr Signalkanäle auf kleinerem Raum.

· Bessere Signalintegrität: Optimiertes Pin-Layout und Abschirmungsdesign reduzieren das Übersprechen.

· Kabelanschluss: Unterstützt den Anschluss externer Geräte über Kabel, wodurch der Platzbedarf des Gehäuses nicht eingeschränkt wird.

Das Training großer KI-Modelle erfordert die Zusammenarbeit von Hunderten oder sogar Tausenden von GPUs. Die Hochgeschwindigkeitsverbindung gewährleistet den Austausch von Gradientendaten und Modellparametern zwischen den GPUs mit niedriger Latenz und hoher Bandbreite. Die Retimer-Technologie garantiert die Signalintegrität über komplexe Backplanes und Langstreckenkabel.

HPC-Anwendungen wie wissenschaftliche Berechnungen, Simulationen und Gensequenzierung haben extrem hohe Anforderungen an die Speicherbandbreite und -kapazität. Die CXL-Speichererweiterung in Kombination mit der Retimer-Signalverbesserung kann Speicherpools mit großer Kapazität und hoher Bandbreite aufbauen, um Rechenaufgaben zu beschleunigen.

Cloud-Gaming-Server virtualisieren mehrere GPU-Instanzen auf einem einzigen physischen Rechner, um Echtzeit-Rendering-Dienste für verschiedene Nutzer bereitzustellen. Hochgeschwindigkeitsspeicher und -speicherzugriff sind entscheidend für ein Spielerlebnis mit geringer Latenz.

Software-definierte Speicherlösungen (SDS), die auf Standardservern basieren, müssen eine große Anzahl von NVMe-SSDs anschließen. PCIe 5.0 Retimer-Erweiterungskarten ermöglichen eine SSD-Erweiterung mit hoher Dichte zum Aufbau von Hochleistungs-Speicherpools.

Angesichts der immer komplexeren Anforderungen an Hochgeschwindigkeitsverbindungen sollten Systementwickler die folgenden Faktoren berücksichtigen:

· Übertragungsentfernung: Bewerten Sie die physische Entfernung, die Signale zurücklegen müssen, um festzustellen, ob eine Retimer-Erweiterung erforderlich ist.

· Fahrspur-Konfiguration: Wählen Sie die geeigneten PCIe-Verzweigungsmodi (x16/x8/x4) je nach Geräteanforderungen.

· Protokoll-Unterstützung: Bestätigen Sie, ob die Unterstützung des CXL-Protokolls erforderlich ist und welche spezifischen Funktionsanforderungen CXL hat.

· Thermischer Entwurf: Hochgeschwindigkeits-Retimer-Chips haben einen relativ hohen Stromverbrauch und erfordern geeignete thermische Lösungen.

· Überprüfung der Kompatibilität: Stellen Sie sicher, dass die Erweiterungskarte mit Motherboards, Betriebssystemen und Zielgeräten kompatibel ist.

Der Beginn der KI-Ära verändert das Design der Rechenzentrumsarchitektur. Von der Hochgeschwindigkeitsübertragung mit PCIe 5.0 über die Signalregeneration mit der Retimer-Technologie bis hin zur Speichererweiterung mit dem CXL-Protokoll - jede Technologie unterstützt die Erschließung des KI-Computing-Potenzials.

Für Unternehmen, die eine KI-Infrastruktur planen, ist es wichtig, die Prinzipien und Anwendungsszenarien dieser zugrundeliegenden Technologien zu verstehen, um eine rationellere Technologieauswahl zu treffen und leistungsstarke, hochzuverlässige Computerplattformen aufzubauen.

Linkreal (LR-LINK) ist ein nationales Hightech-Unternehmen, das sich auf Konnektivitätslösungen für Server und Rechenzentren spezialisiert hat. Sein Produktportfolio umfasst Ethernet-Netzwerkadapter, Speichererweiterungskarten, GPU-Erweiterungslösungen usw. Das Unternehmen hält mit den Entwicklungstrends von PCIe 5.0 und CXL-Technologien Schritt und bietet Hochgeschwindigkeits-Signalerweiterungslösungen für KI-Server, High-Performance-Computing, softwaredefinierte Speicherung und andere Anwendungsszenarien.